Moet een zelfrijdende auto de passagier doden om meer levens te besparen?

Met de opkomst van de zelfrijdende auto ontstaan er meerdere morele en ethische dilemma’s. Moet een zelfrijdende auto bijvoorbeeld de passagier van de auto opofferen om meerdere levens van anderen te sparen?

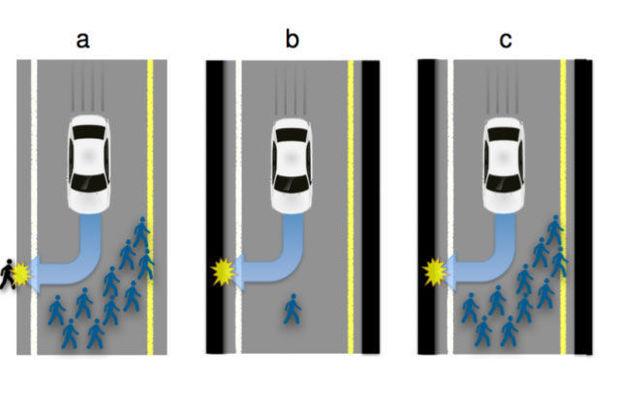

Stelt u voor: u zit in een zelfrijdende auto en na een bocht is het onmogelijk om uit te wijken voor 10 personen die op een weg lopen met muren aan beide kanten. Moet de auto dan uitwijken en tegen de muur rijden en u vrijwel zeker verwonden of zelfs doden? Of moet hij proberen te stoppen – waardoor de groep vrijwel zeker geraakt wordt en u ongedeerd blijft?

Dat was de vraag die onderzoekers van de Toulouse School of Economics zichzelf stelden en waar I Fucking Love Science over schrijft.

Deze hypothetische situatie wordt steeds waarschijnlijker met de opkomst van de (deels) zelfrijdende auto. Op dit moment rijden er alleen zelfrijdende auto’s op snelwegen, om dit soort situaties vooralsnog te vermijden. Want voordat er overal gereden kan worden met zelfrijdende auto’s moeten dit soort ethische kwesties besproken worden, stellen de onderzoekers. De manier waarop deze kwesties opgelost worden kunnen in de toekomst van groot belang zijn op de manier waarop de technologie toegepast zal worden.

De onderzoekers legden het voorbeeld van de voetgangers op de weg voor aan een groep mensen met verschillende scenario’s. Ze pasten bijvoorbeeld het aantal personen in de auto aan, het aantal mensen in de groep en de leeftijd van de mensen in de auto – om zo ook kinderen mee te nemen in het onderzoek.

Opofferen voor de groep

Het resultaat is wellicht niet heel verrassend: mensen willen de passagier (of chauffeur) van de zelfrijdende auto opofferen voor het ‘grote goed’ – de groep dus. Maar ze doen dit vooral als ze zichzelf niet als de passagier zien. 75 procent van de respondenten vond het normaal om uit te zwenken, maar slechts 65 procent vindt dat de auto daadwerkelijk zo geprogrammeerd moet worden. “Op een schaal van -50 (bescherm de passagier ten allen kosten) tot +50 (redt zoveel mogelijk levens), was het gemiddelde +24”, schrijven de onderzoekers.

Grijs gebied

Het resultaat van het onderzoek geeft het grijze gebied aan: Zijn er wetten nodig om zelfrijdende auto’s ten allen tijden de emotieloze beslissing te maken om de grote groep te redden? Of mogen auto’s bijvoorbeeld ingesteld worden op verschillende vormen van redelijkheid? “Als een fabrikant verschillende versies van het morele algoritme aanbiedt en de koper kiest er één van, is de koper dan aansprakelijk bij een ongeluk?”, vragen de onderzoekers zich af.

Dit soort dilemma’s zorgen ervoor dat de zelfrijdende auto niet gelijk massaal in het straatbeeld opduiken. Eerst moet de wetgeving hier op aangepast worden.

Veiliger dan mensen

Maar ondanks morele dilemma’s stellen onderzoekers van MIT dat zelfrijdende auto’s zeker veiliger zijn dan menselijke chauffeurs. “Als minder mensen zelfrijdende auto’s kopen, omdat ze ingesteld zijn om de passagier te doden, blijft het waarschijnlijker dat meer mensen doodgaan door het gebruik van normale auto’s, omdat die bij veel meer ongelukken betrokken raken”, schrijft MIT. “Het resultaat is een Catch-22 situatie”, – een situatie waarbij niet te kiezen valt.

Er is weinig twijfel dat de toekomst van de auto zelfrijdend is, maar zoals de studie aantoont zijn er nog zeer grote uitdagingen die moeten worden aangegaan voordat het zover is.

Fout opgemerkt of meer nieuws? Meld het hier