Technologie Twijfelt Ook van ingenieur en auteur Filip Van den Abeele belicht dertien dilemma’s over innovatie en ethiek. Het boek werpt een blik op de lusten en lasten van technologie zoals AI, big data, DNA of genetisch gewijzigde gewassen. Het schenkt aandacht aan wetenschappelijke vooruitgang, maar gaat de stekelige ethische vragen niet uit de weg. En komt tot de slotsom dat ook technologie soms twijfelt. Je krijgt hier alvast een voorsmaakje, uit het hoofdstuk Artificiële intelligentie: het einde van het mensdom?

Zijn computers kleurenblind?

Dankzij zelflerende neurale netwerken wordt artificiële intelligentie steeds slimmer. Maar de machines doen tijdens hun training een beroep op enorm grote datasets. En die data blijven vaak verstoken van superintelligentie. Dat mocht Microsoft aan den lijve ondervinden bij de lancering van hun chatbot op Twitter. De chatbot heette Tay, als afkorting voor ‘Thinking about You’, en de avatar hield het midden tussen een knappe jonge vrouw en een cyborg. Microsoft wilde dat Tay luchtige en vrolijke gesprekken zou voeren met de gebruikers van Twitter. De technologiereus zag de chatbot als een experiment in het beter leren begrijpen van gesprekken tussen jongvolwassenen: ‘Hoe meer Tay interageert, hoe slimmer ze wordt. Dankzij artificiële intelligentie kan ze haar taalregister verfijnen om beter in te spelen op de bezorgdheden en besognes van 18- tot 24-jarigen.’ De missie van Tay klonk optimistisch, maar ze was vooral grenzeloos naïef. Want Microsoft beging de kapitale blunder om precies de data-uitstoot van die adolescenten te gebruiken om Tay te trainen. Het was een kwestie van uren voor de trollen op Twitter dat ook begonnen te begrijpen. Ze belaagden de chatbot met een spervuur aan brutale, misogyne en racistische vuilspuiterij. En Tay leerde vlijtig, en vooral erg snel. Binnen de kortste keren liet ze weten dat ze alle feministen haatte. Ze wenste hen een pijnlijke dood toe, en dat ze mochten branden in de hel. Ze tweette dat George Bush het meesterbrein achter de aanslagen van 9/11 was. En ze gaf Hitler gelijk, want ‘ook ik haat Joden’.

Artificiële intelligentie die leert uit gekleurde data, zal discriminatie in de hand werken.

Het is weinig wenselijk machines te bouwen die vooroordelen versterken en discriminatie in de hand werken. Maar vaak zijn de vooroordelen in de data impliciet, en wordt onbewust gediscrimineerd. Het leeuwendeel van de softwareontwikkelaars in Silicon Valley zijn blanke jonge mannen tussen 20 en 40 jaar oud. Het kan verklaren waarom virtuele assistenten meisjesnamen als Siri of Alexa meekrijgen. En ook Cortana spreekt je toe met een zoetgevooisde vrouwenstem. De whizzkids die de apps ontwikkelen, gaan eraan voorbij dat ze hun technologie met morele waarden beladen. De virtuele assistent wordt geacht alles te weten, meteen te antwoorden, en je de klok rond ten dienste te staan. Waarom moet zo’n app dan steeds een vrouw zijn? Ook bij Apple zijn mannen, vooral in functies rond ontwerp en programmeren, ruim in de meerderheid. De eerste versie van hun Apple Health-app beloofde ‘alle parameters die je interesseren’ te kunnen opvolgen. Door het tellen van je stappen, het meten van je hartslag en het opvolgen van je dieet, bood de app een panoramisch zicht op je gezondheid. Maar Apple vergat een feature waarop zowat de helft van de wereld zat te wachten: een dagboek om de menstruatiecyclus op te volgen. De overmaat aan testosteron op het Applehoofdkantoor in Cupertino is wellicht ook de oorzaak dat de iPhone te groot is voor vrouwenhanden.

Technologie is tot op zekere hoogte een afspiegeling van haar ontwerpers. En algoritmes die te goeder trouw ontworpen zijn, kunnen toch vrouwen discrimineren. Ik nodig je uit om een afbeelding van een professor te googelen. Je vindt de eerste foto van een vrouwelijke hoogleraar pas ver na de tweede pagina (en dat is naar het schijnt de beste plaats om een lijk te verbergen). Soms wordt technologie, door onachtzaamheid bij het ontwerp, zelfs ronduit racistisch. Een Nigeriaanse man postte een filmpje van een automatische zeepverdeler op YouTube. Het toestel weigerde zijn donkere huid te herkennen, maar werkte feilloos bij zijn blanke reisgezel. Pas toen hij zijn hand bedekte met een stuk toiletpapier, kreeg de man een kwakje zeep. De intenties van de ontwerpers waren ongetwijfeld niet racistisch. Maar ze stonden er niet bij stil dat de microkosmos op een luchthaven veel diverser is dan die op hun eigen zolderkamer. En zo belaadden ze de zeepverdeler met een onfris oordeel: geen zeep verspillen aan kleurlingen.

Over het boek

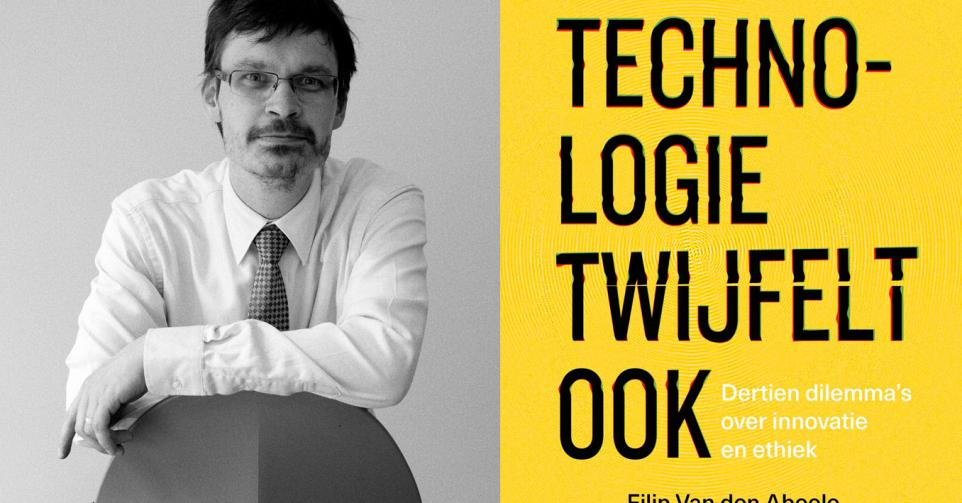

Technologie Twijfelt Ook

Filip Van den Abeele

Pelckmans Uitgevers

ISBN 978-94-6401-443-3

27 euro

Paperback, 608 bladzijden

Over de auteur

Filip Van den Abeele is wetenschapper, ingenieur en ondernemer. Hij was jarenlang chef wetenschap bij de VRT voor programma’s als De laatste show en Ook getest op mensen. Als veelgevraagd keynotespreker over onder meer Industrie 4.0, big data en artificiële intelligentie is hij een ambassadeur van Science, Technology, Engineering & Mathematics (STEM).