Data News selecteert de beste artikels van 2017. Dit jaar werd duidelijk dat Microsoft grootse plannen heeft met artificiële intelligentie. Deze zomer stelde het techbedrijf niet alleen apps voor die blinden helpen ‘zien’ en presentaties automatisch vertalen, maar sprak het ook over ethiek en de schaduw van HAL 9000.

“Het zijn boeiende tijden voor AI,” zegt Harry Shum, executive vice president voor Microsofts AI & Research departement. “De technologie biedt ons gigantisch veel opportuniteiten, maar we moeten ook goed nadenken over de impact ervan. Over jobs, veiligheid, ethiek enzovoort.” Hij zet meteen de toon voor Microsoft’s AI-evenement in Londen. Daar toont het bedrijf met enige trots een reeks toepassingen en applicaties van zijn AI-onderzoek. Opvallend daarbij: veel dan die toepassingen vallen netjes in de categorie ‘wereldverbeteraar’.

Zo is er Seeing AI, een app voor blinden die op de iOS app store te vinden is. De app maakt gebruik van Microsofts beeldherkenning om een foto te beschrijven. Maak bijvoorbeeld een beeld van een glimlachende dame en de app babbelt: “Een vrouw van 35 met bruin haar die er gelukkig uitziet.”

Er is ook InnerEye, een toepassing die machine learning gebruikt om dokters te helpen sneller 3D-beelden van organen te bouwen. Die worden ingezet om de bestraling van kankercellen fijner af te stellen.Een dokter is echter al snel een paar uur bezig met het aanduiden van, pakweg, de blaas op elke foto van een MRI-scan. Met beeldverwerkingssoftware en machine learning moet dat een pak sneller lukken.

Natuurlijke taal

Naast AI voor beeldherkenning en machine learning, zet Microsoft ook sterk in op verwerking van natuurlijke taal. “We zijn al jaren bezig met machine translation, automatische vertaling van natuurlijke taal,” aldus Shum, “en het doel is altijd geweest om een gesprek tussen twee personen in real time te vertalen. Daar zijn we volgens mij ook in geslaagd. Er is nu Skype Translator, waarmee je gesprekken in Skype in real time kan vertalen, en dat werkt goed.” Hetzelfde stukje software is ondertussen ook in API-vorm beschikbaar onder de naam Microsoft Translator. Daarop verder bouwend stelt het bedrijf ook zijn nieuwste product in het gamma voor: een vertaalplug-in voor Powerpoint, die al downloadbaar is. “Die biedt real time vertaling naar verschillende talen voor wanneer je een presentatie geeft,” legt Marcel Tilly, program manager bij Microsoft AI & Research uit. De software herkent wat de spreker (in een headset) vertelt, en zet er vervolgens ondertitels bij. “We hebben dat herkenningsmodel getraind,” legt hij uit, “zodat het ook bij sprekers dialecten en accenten de juiste ondertitels zet.” Tilly, overduidelijk een Duitser, toont vervolgens netjes hoe dat werkt in een engelstalige demo. “Zelfs als ik bijvoorbeeld de naam van een Frans dorpje fout uitspreek, zie je dat de ondertitels juist zijn,” legt hij uit. In tweede instantie wordt er aan die ondertitels een vertaling gehangen. Met de eerder genoemde Microsoft Translator kan je de presentatie volgen met ondertitels in je eigen taal.

De wereld redden

Moest het nog niet duidelijk zijn dat Microsoft met AI de wereld wilt redden, dan is er nog ‘AI for Earth’, een set tools die gemaakt zijn om mensen te helpen die met klimaatsverandering bezig zijn. “We willen echt wel applicaties maken die goed zijn voor de maatschappij,” legt Eric Horvitz, technical fellow en managing director Microsoft Research uit. “We gebruiken grote datasets om mensen in ontwikkelingslanden maar ook de ontwikkelde wereld te helpen.” Hij geeft het voorbeeld van een wind- en weerkaart die Microsoft ontwikkelde op basis van open data van weerstations. Die wordt nu gebruikt door enkele vliegmaatschappijen om betere vliegroutes uit te bouwen.

We willen een AI maken die mensen begrijpt

Om deze en andere applicaties sneller klaar te krijgen, heeft het bedrijf nu Microsoft Research AI in het leven geroepen, een ‘incubator hub’ voor artificiële intelligentie. Het doel daarvan is, onder meer, om meer ‘algemene intelligentie’ te maken voor AI, zegt Eric Horvitz: “Verschillende AI’s hebben elk competenties in hun specialisatie. We willen die samenbrengen in een AI die mensen begrijpt, die weet waar onze blinde hoeken zijn, onze vooroordelen, de lacunes in ons geheugen, en die ons specifiek daar kan compenseren.”

Wie is er bang van AI?

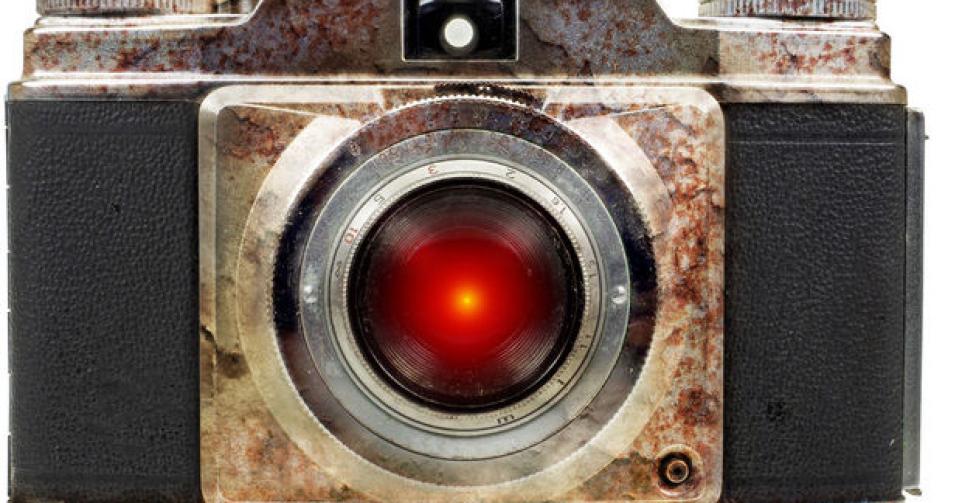

Met zo’n allesomvattende plannen voor AI is een discussie over ethiek niet ver weg. “We willen natuurlijk een situatie vermijden zoals in 2001: a Space Odyssey,” zegt Harry Shum. In de filmklassieker neemt een artificiële intelligentie genaamd HAL 9000 op eigen houtje een ruimtestation over, of de inwoner van dat ruimtestation het daar nu mee eens is of niet. Het is waarschijnlijk het bekendste voorbeeld van onze ‘AI-angst’, de vrees om de controle te verliezen. “Je ziet wel dat er een soort vrees is,” geeft ook Emma Williams, general manager AI Products Design toe, “een biologische angst voor een nieuw dominant ras. Daarom houden we vast aan enkele stevige principes wanneer we AI ontwikkelen. Mensen blijven de helden, mensen staan centraal.”

“We willen natuurlijk een situatie vermijden zoals in 2001: a Space Oddyssey

“Het is belangrijk om van bij het begin ethiek in AI te stoppen,” zegt Shum nog. “We kunnen dat niet alleen, daarom hebben we een partnerschap opgestart rond AI, een non-profit om best practices op AI technology te delen.” De groep, waar ook IBM, Google, Facebook en Amazon in zit, heeft de lichtjes propagandistische naam Partnership on Artificial Intelligence to Benefit People and Society, en moet onder meer mensen van hun AI-vrees afhelpen. Er zou ook een ethisch adviesorgaan in de maak zijn (het Aether Advisory Panel ofte’ AI and Ethics in Engineering and Research’ panel) dat een oogje in het zeil moet houden.

Over vooroordelen en verantwoordelijkheid

Blijft nog de vraag hoe ze al die ethiek gaan regelen, nu keer op keer blijkt dat AI niet altijd even objectief is. AI heeft de neiging, bijvoorbeeld, om al dan niet bewuste vooroordelen over te nemen van de mensen die hen ontwikkelen. Vaak heeft dat te maken met de datasets waarop de AI zichzelf traint. “We zijn geëvolueerd naar een nieuw soort software,” zegt Chris Bishop, technical fellow en de baas van Microsofts Research lab in Cambridge. “Vroeger gingen we manueel software schrijven en telkens aangeven wat het programma allemaal moest kunnen. Nu schrijven we software die in staat is te leren, en dan gaan we die trainen.” Wanneer die software vervolgens belangrijke beslissingen moeten nemen, in pakweg de gezondheidszorg, dan moet ie dat natuurlijk wel goed doen. Bishop zelf heeft het over de verantwoordelijkheid van de technoloog. “Het is natuurlijk een kwestie van datasets,” zegt hij. “Soms merk je dat daar een vooroordeel in zit dat door de gemeenschap als ongepast wordt gezien, en dan gaan we dat eruit halen.”

De auto van de toekomst laat je niet alleen de bassen van je luidsprekers fijntjes instellen, maar ook hoeveel je geeft om voetgangers

“Inherente vooroordelen kan je oplossen met grotere datasets,” geeft Eric Horvitz aan, “maar soms is ook transparantie al een belangrijke eerste stap. We hadden een tijd terug bijvoorbeeld gezichtsherkenning ontwikkeld en die bleek niet te werken op kinderen. Dus zijn we naar het lab gegaan en hebben we de dataset opgevraagd, en dan bleek dat er voornamelijk volwassenen in zaten.” Om dat op te lossen, zegt Horvitz, kan je de dataset aanpassen, maar je kan al beginnen met een disclaimer: ‘Pas op, niet te gebruiken voor mensen jonger dan twaalf’. Voor Horvitz zijn een aantal van de typische AI-problemen misschien wel gewoon op te lossen met meer informatie. “Kijk bijvoorbeeld naar de zelfrijdende wagens en het trolleyprobleem (waarbij de zelfrijdende wagen moet kiezen om bijvoorbeeld een kind aan te rijden, of drie volwassenen, nvdr.). Dat is een groot probleem voor ethische AI waar veel mensen mee bezig zijn. Je kan je voorstellen dat we misschien ook mensen kunnen informeren. In plaats van één stand die altijd voorrang geeft aan inzittenden, en het overstekende hert heeft maar pech, kan je je inbeelden dat er een uitgebreide tutorial komt, en een reeks schuivers, waarmee de chauffeur zelf de AI instelt.” De auto van de toekomst, zo beelden we ons in, laat je niet alleen de bassen van je luidsprekers fijntjes instellen, maar ook hoeveel je geeft om voetgangers.

Als technoloog wil ik dan wel AI maken die zo krachtig mogelijk is, maar als burger wil ik misschien niet dat alles door een AI beslist wordt

Het is een boeiende mogelijkheid, die alvast de rechterlijke strijd om ‘wie is er verantwoordelijk‘ niet makkelijker gaat maken wanneer een zelfrijdende wagen voor de eerste keer iemand van de weg maait. Maar het is alvast hoopgevend dat Microsoft zich bewust is van het feit dat niet iedereen even optimistisch naar de AI-toekomst kijkt als zij zelf. “Hollywood helpt alvast niet om de vrees van mensen weg te nemen,” lacht Bishop. Maar er wordt aan gewerkt. Ook als het bijvoorbeeld om inherente vooroordelen gaat. “We zetten erg hard in op feedback van de gemeenschap,” zegt Bishop. “We werken onder meer samen met het Royal Institute (een Britse organisatie die zich bezig houdt met wetenschappelijk onderzoek en onderwijs) om af te toetsen waar we mee bezig zijn. Dat is ook heel belangrijk. Want als technoloog wil ik dan wel AI maken die zo krachtig mogelijk is, maar als burger wil ik misschien niet dat alles door een AI beslist wordt.”